大模型训练完成之后可以直接使用吗?该怎么使用训练好的大模型? 原创

学习机器学习的人大部分都知道怎么设计并训练一个模型,但开发模型的目的是为了解决业务问题,所以怎么使用大模型也是重中之重。

刚训练好的大模型事实上虽然可以用,但由于没有用户接口,所以只能自己用,无法对外提供服务;所以,刚训练好的大模型需要经过一些处理才可以使用,包括数据预处理,接口开发等。

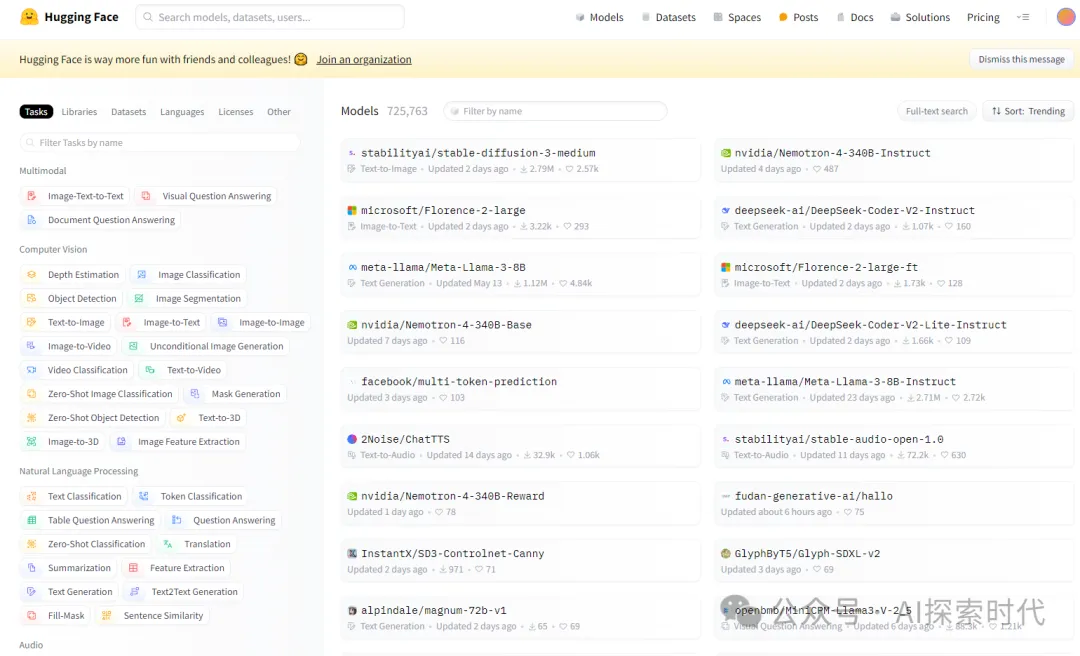

huggingface官网地址:https://huggingface.co/models 需科学上网

01、大模型加载与保存

训练一个大模型,在训练完成之后最重要的就是要把模型给保存下,然后在使用的时候加载。

在什么情况下需要保存模型?

保存模型主要有两种情况,第一种是重新设计了一个新的模型,第二种是微调过的模型。

当然不论是何种原因,保存模型也有两种方式,一种是直接把模型进行保存,不论是模型本身还是模型参数。第二种是使用字典方式保存模型参数。

代码如下所示,这里使用的是pytorch自定义模型,如果是从网络中加载的其它模型,可以根据其具体的实现进行保存。

import torch

from torch import nn

# 神经网络结构 当作例子没有具体实现

class MyModel(nn.Module):

def __init__(self):

super(MyModel, self).__init__()

pass

def forward(self, x):

return x

# 创建一个模型对象

model = MyModel()

# 第一种保存模型的方式

torch.save(model, "my_model.pth")

# 第二种保存模型的方式 使用dict字段保存参数

torch.save(model.state_dict(), "dict_my_model.pth")可能会有人有疑问,没有训练过的模型也可以保存吗?

虽然很多人都会使用别人训练好的模型,但有时我们只需要使用其模型结构,不需要其训练的参数,所以就会有人把没有训练过的模型进行保存。然后让别人可以用没用被数据“污染”过的新模型。

比如,pytorch从官网加载模型时就有一个参数,pretrained=false来加载未训练过的模型。当然,用户也可以选择训练过的模型进行微调。

模型的加载

模型既然可以被保存,那么就可以被加载。保存模型有两种方式,加载模型也有两种方式。

第一种方式保存就直接加载,而第二种方式保存就需要先创建一个模型,然后再加载。

需要注意的说,这里加载的是自定义模型,所以一定要把神经网络的结构给引入进来,下面代码的神经网络结构就是MyModel。否则会报错找不到模型,而如果是从网络中加载模型则不会出现这个问题。

import torch

from torch import nn

# 神经网络结构 当作例子没有具体实现

class MyModel(nn.Module):

def __init__(self):

super(MyModel, self).__init__()

pass

def forward(self, x):

return x

# 创建一个模型对象

model = MyModel()

# 第一种保存模型的方式

torch.save(model, "my_model.pth")

# 第二种保存模型的方式 使用dict字段保存参数

torch.save(model.state_dict(), "dict_my_model.pth")

# 第一种加载模型的方式 有了这个之后就不需要使用 model = MyModule()创建模型了

load_model = torch.load("my_model.pth")

print(load_model)

# 第二种加载方式 这里只会加载模型的参数

dict_load = torch.load("dict_my_model.pth")

print(dict_load)

# 因此,需要先创建模型,再从字典中加载参数

dict_model = MyModel()

dict_model.load_state_dict(torch.load("dict_my_model.pth"))

print("------------------")

print(dict_model)02、使用模型的三种方式

使用模型大概有以下三种方式:

第一种方式是直接调用第三方模型服务公司的API接口,比如chatGPT的接口,通义千问接口和百度文心一言等接口。

这种方式最简单,也不需要懂得大模型的技术,只需要有编程基础会调用接口即可。

而后面两种其实是两种情况,就是自己部署大模型。

自己部署大模型分为两种情况,第一种是使用别人训练或微调好的模型,比如huggingface上的模型,pytorch官网提供的模型等;第二种是自己设计并训练模型。

两者的区别就是,第一种使用别人的模型,就需要按照别人的要求和规则去使用或训练模型。比如,它们可能会对模型进行简单的输入处理和API封装,我们自己也可以在其基础之上对模型进行更加完善的设计。

如下所示,是使用huggingface上的大模型。from_pretrained(model_id)就是从huggingface仓库中加载大模型。

from transformers import AutoTokenizer, AutoModelForCausalLM

# 大模型名词

model_id = "shenzhi-wang/Llama3-8B-Chinese-Chat"

# 加载分词器 在自然语言处理中,需要对文字进行分词 并转换为神经网络能够识别的向量格式

tokenizer = AutoTokenizer.from_pretrained(model_id)

# 加载大模型

model = AutoModelForCausalLM.from_pretrained(

model_id, torch_dtype="auto", device_map="auto"

)

"""

用户使用,按照大模型提供的输入案例来操作

"""

messages = [

{"role": "system", "content": "You are Llama3-8B-Chinese-Chat, which is finetuned on Llama3-8B-Instruct with Chinese-English mixed data by the ORPO alignment algorithm. You, Llama3-8B-Chinese-Chat, is developed by Shenzhi Wang (王慎执 in Chinese). You are a helpful assistant."},

{"role": "user", "content": "介绍一下你自己"},

]

# 数据预处理

input_ids = tokenizer.apply_chat_template(

messages, add_generation_prompt=True, return_tensors="pt"

).to(model.device)

# 大模型只能识别向量格式的数据,所以在开始之前需要对数据进行预处理

outputs = model.generate(

input_ids,

max_new_tokens=1024,

do_sample=True,

temperature=0.6,

top_p=0.9,

)

# 获取结果

response = outputs[0][input_ids.shape[-1]:]

print(tokenizer.decode(response, skip_special_tokens=True))第二种自定义模型,我们就需要自己对大模型进行预处理和接口封装。

import torch

from torch import nn

# 神经网络结构 当作例子没有具体实现

class MyModel(nn.Module):

def __init__(self):

super(MyModel, self).__init__()

pass

def forward(self, x):

return x

# 创建一个模型对象

model = MyModel()

# 第一种保存模型的方式

torch.save(model, "my_model.pth")

# 第二种保存模型的方式 使用dict字段保存参数

torch.save(model.state_dict(), "dict_my_model.pth")

# 第一种加载模型的方式 有了这个之后就不需要使用 model = MyModule()创建模型了

load_model = torch.load("my_model.pth")

print(load_model)

# 第二种加载方式 这里只会加载模型的参数

dict_load = torch.load("dict_my_model.pth")

print(dict_load)

# 因此,需要先创建模型,再从字典中加载参数

dict_model = MyModel()

dict_model.load_state_dict(torch.load("dict_my_model.pth"))

print("------------------")

print(dict_model)

""" 数据预处理 """

def process_prefix(param):

# params是输入参数,自然语言处理中就是字符串,计算机视觉处理中就是图片或视频

# 把参数转换为张量/向量

inputs = torch.Tensor(param)

"""

当然,这里只是简单举个例子,实际的预处理要比这复杂的多,不但要实现功能,还有保证接口的可扩展性,以及上层功能的调用

"""

return inputs

# 把用户输入转化为向量后 输入到模型中

resp = dict_model(process_prefix(""))

def process_post(resp):

"""

这里主要对模型的输出进行处理,不同的模型输出数据格式不一,所以为了使用的方便,需要对模型输出进行处理

"""总的来说,模型的使用就类似于模型设计中的输入层和输出层,由于每个模型的输入和输出都不一样,所以每个模型的输入和输出都需要进行特殊处理。

开发者对模型进行包装之后,就可以通过API接口或SDK的形式提供给业务人员调用。

本文转载自公众号AI探索时代 作者:DFires

原文链接:https://mp.weixin.qq.com/s/8ThSarUkwOgJ46lTAvCJWQ