如何评估大语言模型生成结果的多样性

1、论文的背景

关于大型语言模型(LLM)的一个开放性问题是,这些模型从预训练数据中学习了哪些模式,以及这些模式是否能够在下游任务和数据集中普遍适用。虽然先前的研究主要集中在生成质量上,最近也开始关注文本生成的新颖性,但对LLM学习到的模式类型的特征描述还很有限。关于评估大型语言模型(LLM)生成文本多样性的研究主要集中在词级特征上。本文提供了一种句法特征分析方法,用以描述模型中的普遍重复现象,超越了n-gram的范畴。

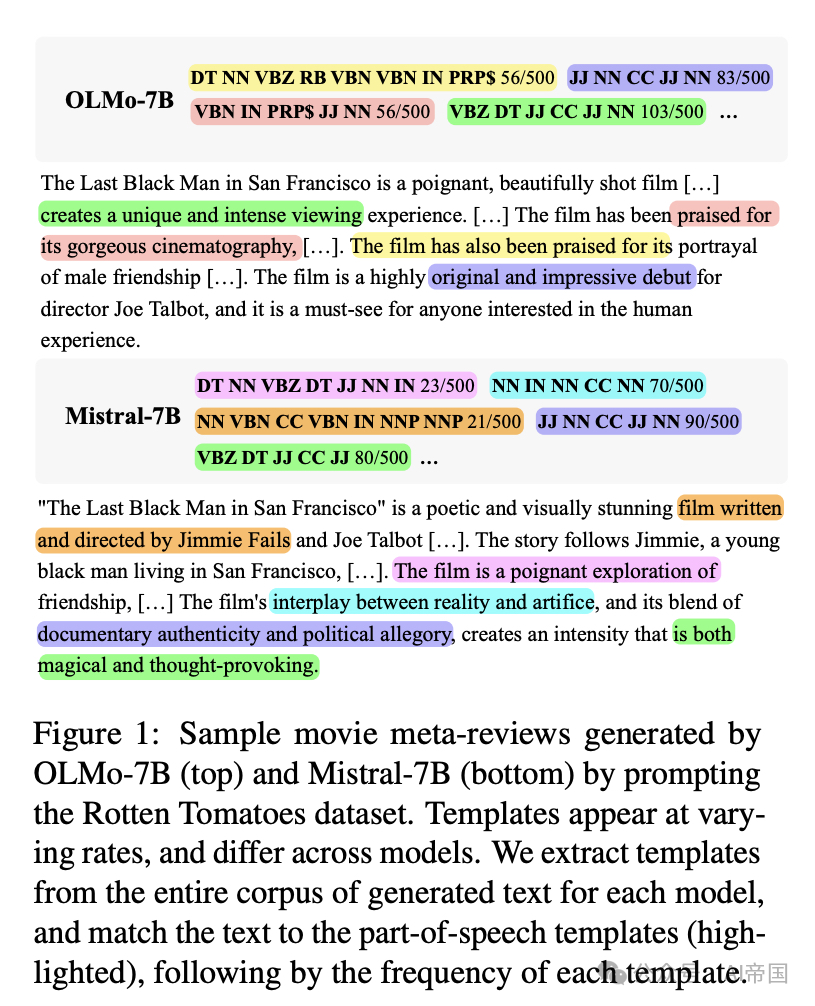

例如,考虑图1中OLMoInstruct生成的文本,这是从一个生成的电影评论摘要语料库中采样的。这是通过提示模型总结一组人工撰写的电影评论而产生的:"《旧金山的最后一个黑人》是一部感人的、拍摄精美的电影[...] 创造了一种独特而强烈的观影体验[...]"。在这个例子中,论文发现总共有35个重复的词性(POS)标签序列,长度为n = 5到8。虽然生成的文本在OLMo的训练数据中并未出现,但论文发现35个序列中有33个(95%)出现在预训练数据中。因此,尽管生成的文本本身是新颖的,但它依赖于从训练数据中学习到的常见句法序列。

2、论文的方法

论文量化并测量了大型语言模型(LLM)在文本生成中使用重复序列的情况。论文引入并聚焦于句法模板,即词性(POS)序列,这是一种能展示多样化模式集的句法抽象。论文首先建立了训练数据中频繁模板与模型在生成过程中依赖这些模板之间的联系。利用这一发现,论文直接连接了训练数据模板统计和模型生成这些模板的倾向。然后,论文评估了几个封闭源模型及其倾向于生成的句法模板,这让论文了解了它们训练数据的属性。

论文首先介绍句法模板,并定义在生成文本中检测和测量这些模板的方法。基于这个定义,论文试图回答以下问题:

RQ1 指令微调的LLM生成的输出有多大程度上是模板化的?

RQ2 论文能否在(预)训练数据中定位模型生成的模板?

RQ3 句法模板能否用于检测数据记忆?

3、论文的效果

论文发现模型生成文本中的大部分(76%)模板可以在预训练数据中找到(相比之下,人类撰写的文本仅有35%),而且这些模板在RLHF等微调过程中并未被覆盖。这种与预训练数据的联系使论文能够分析那些论文无法获取预训练数据的模型中的句法模板。论文还发现,作为特征的模板能够区分不同的模型、任务和领域,并且对定性评估常见模型构造很有用。

最后,论文展示了论文的指标也可以用作记忆的一种更软性版本。例如,虽然Carlini等人(2022)估计有1%的文本被记忆,但论文发现相比逐字记忆,有0.8-3.1%更多的软记忆文本,通常是通过替换数字和生成同义词实现的。

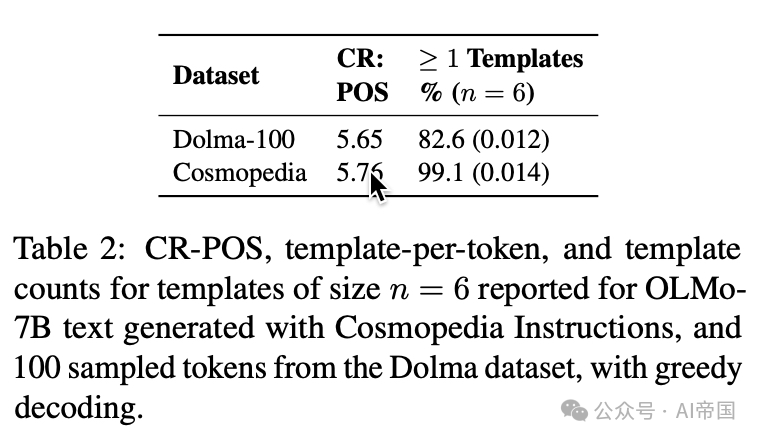

表2显示了两个额外任务的模板率:与Dolma相比(82.6%, 0.012),使用Dolma Cosmopedia进行合成数据生成和数据生成的模板出现率(99.1%)和每个标记的模板数(0.014)更高。

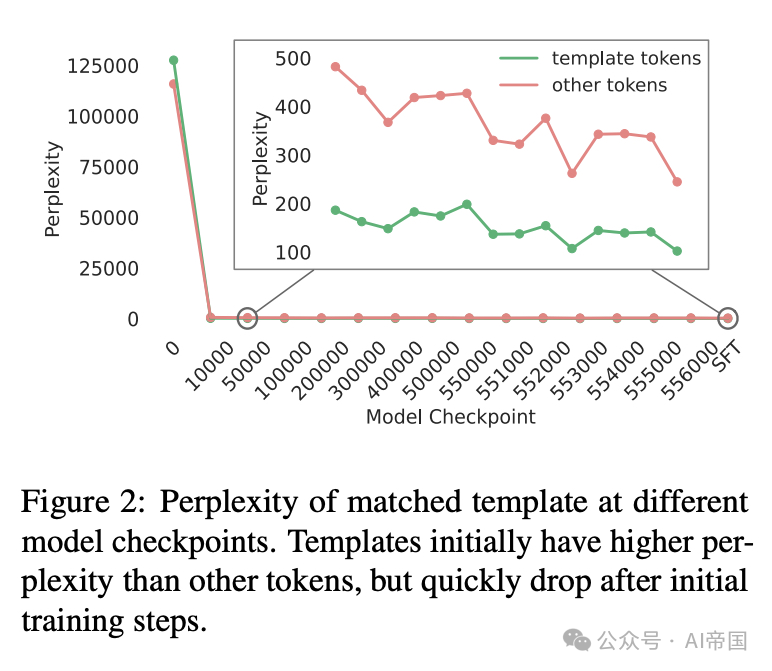

图2显示了各模型检查点的平均困惑度。论文发现模板学习得很快 - 在第一个模型检查点(已训练40亿个标记)就已经出现。非模板标记的平均困惑度下降到约500,而模板的困惑度下降到约200。这些发现令人惊讶,表明模板是在预训练早期就被学习,而不是在微调过程中学习的。在剩余的训练过程中,模板标记的平均困惑度一直保持较低水平

本文转载自 AI帝国,作者: 无影寺

666