大模型爱好者的福音,有了它个人电脑也可以运行大模型了 原创 精华

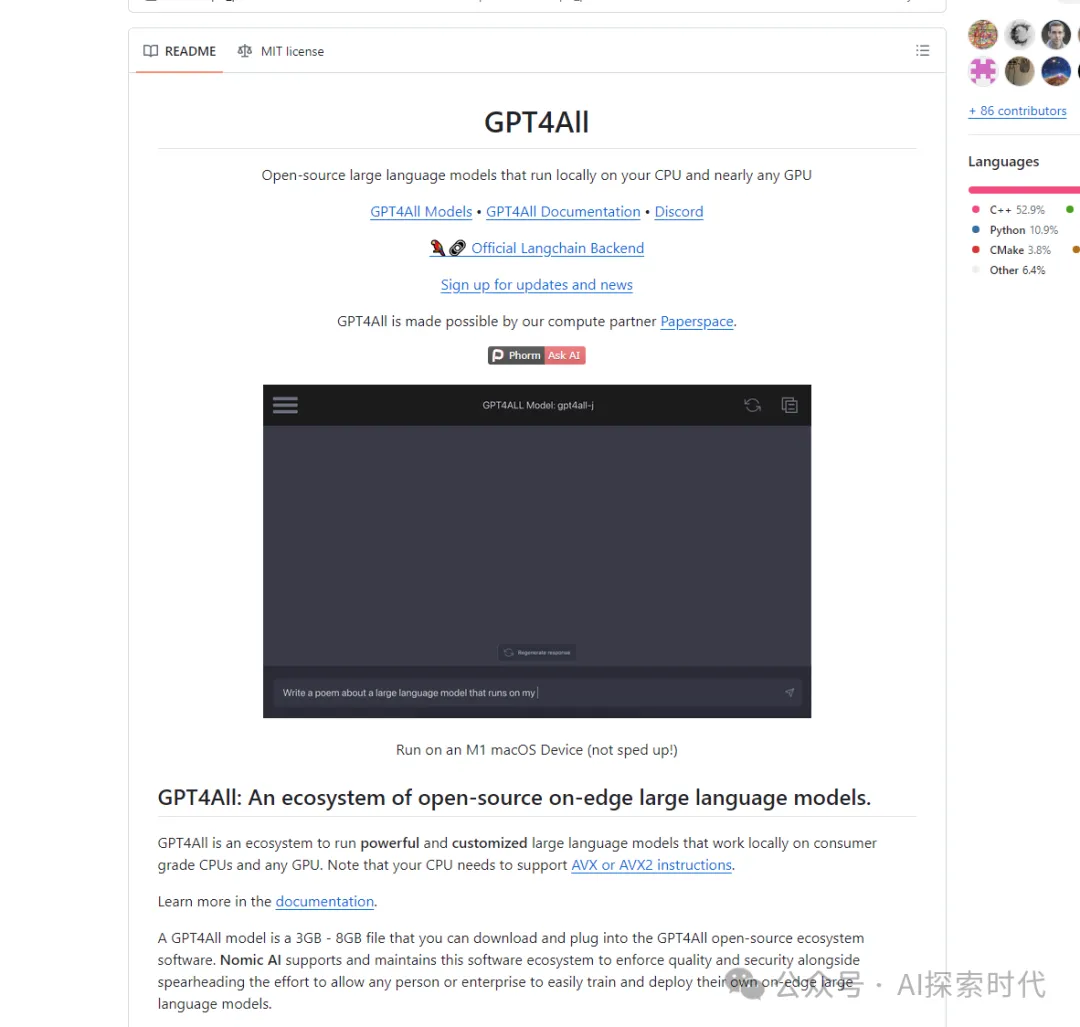

“ GPT4ALL,一个基于llama.cpp开源项目的本地大模型。”

GPT4ALL是一款可以运行在个人电脑上的大模型系统,不需要GPU即可运行,目前支持mac,linux和windows系统。

github地址:https://github.com/nomic-ai/gpt4all

01、什么是GPT4ALL?

不论学习任何东西,首先要明白它是个什么东西。

Open-source large language models that run locally on your CPU and nearly any GPU。

这是GPT4ALL github上的介绍,翻译过来就是可以运行在CPU和GPU上的开源大模型系统。

GPT4ALL不单是一个chatbot软件,而是一个生态系统。用于训练和部署强大且可定制的大型语言模型,可以在消费级CPU上本地运行。它的目标是成为最好的指令微调型的语言助手模型,任何个人或企业都可以自由使用、分发和构建。

我们知道,自从openAI发布chatGPT之后,大模型如雨后春笋般出现,各个公司都开始开发自己的大模型。国内以openAI领头,谷歌,meta,苹果等公司紧随其后。

国内的阿里,百度,腾讯等也先后发布了自己的大模型;可以说大模型进入了群魔乱舞的时代。

但是,对个人和小企业来说,研发一款大模型不论是技术成本,还是资金成本都是不可接受的。但由于个人的学习需要和企业的数据安全性需要,各个公司都希望能够训练一个可以在自己企业内部使用的大模型系统。

而openAI的GPT模型是一个完全闭源的系统,而meta公司开源的Llama大模型,由于其效果不错,所以走进了大家的视线。

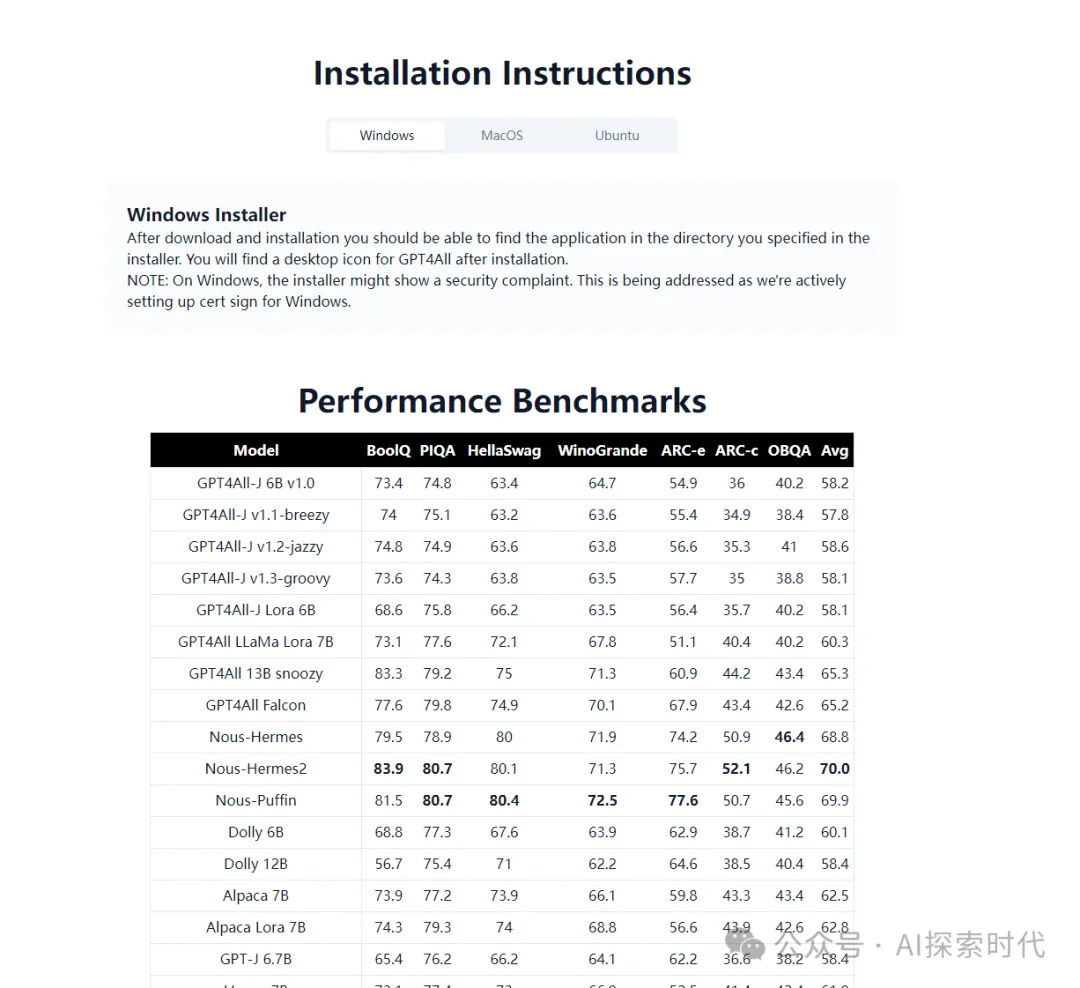

GPT4ALL官方提供的数据对比

而GPT4ALL就是一款建立在Llama模型上的开源系统,当然由于其系统要求低,在本地部署的也属于阉割版的Llama,不过对于个人学习和小企业使用也够了;

而且,GPT4ALL可以自己收集数据进行训练和微调,这样就大大节约了成本;并且更加定制化。

GPT4ALL最大的优点就是开源且能商用,不管是个人还是企业,在不想数据泄露给他人的情况下,能够私有部署和快速训练自己的GPT。而且GPT4All 13B(130亿参数)模型性能直追1750亿参数的GPT-3。

02、GPT4ALL的本地部署以及使用

在个人计算机上部署GPT4ALL有两种方式:

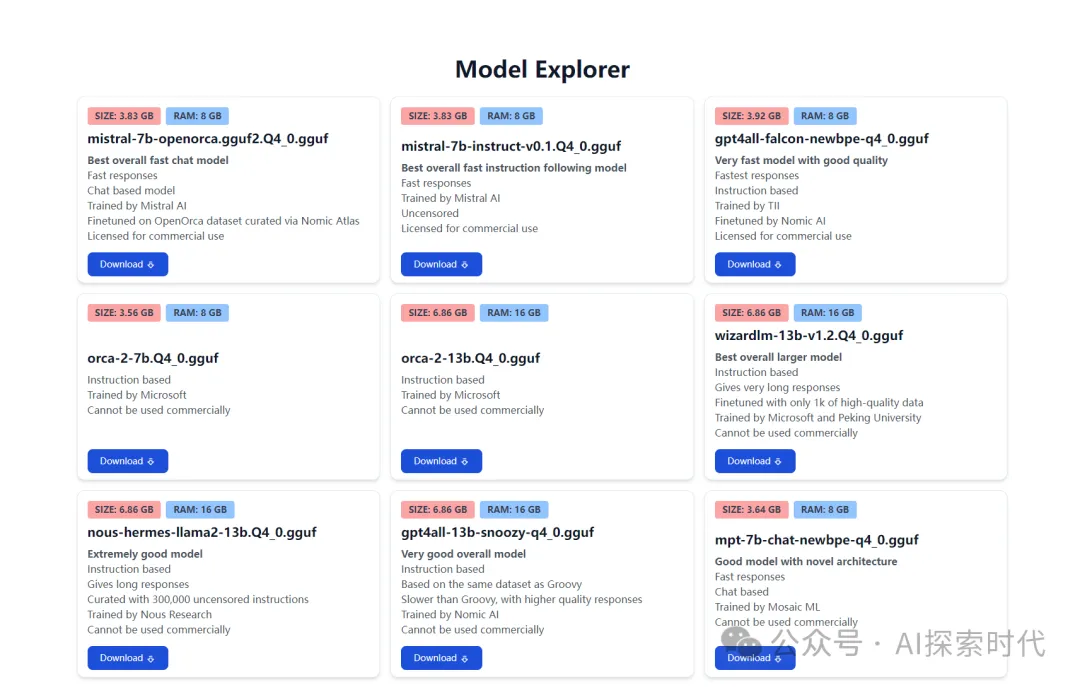

第一种就是从GPT4ALL官网下载客户端,如上图所示,用户可以从搜索框中搜索大模型,并下载到本地即可使用。

或者去官网下载大模型到本地,如下图所示:

官网地址:https://gpt4all.io/index.html

第一种方式可以作为不懂技术的个人爱好者下载使用,第二种方式就是提供给个人开发者和企业使用的一种方式。

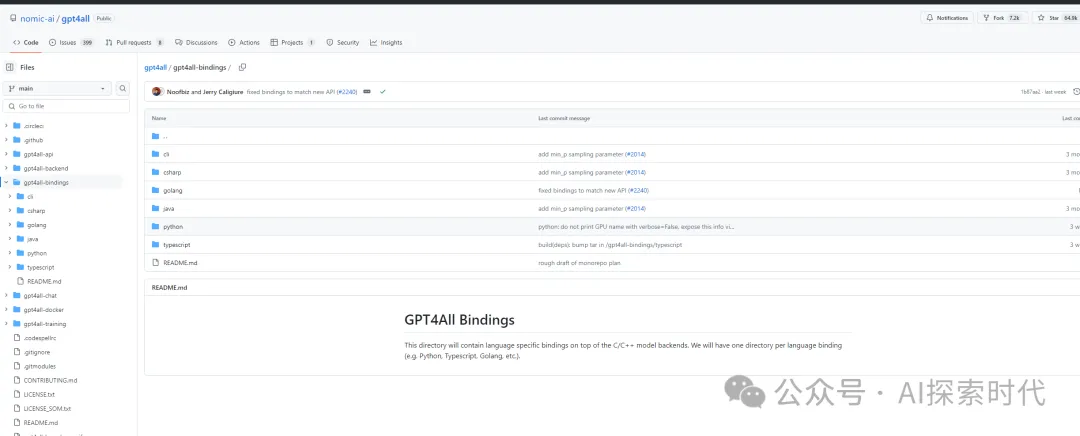

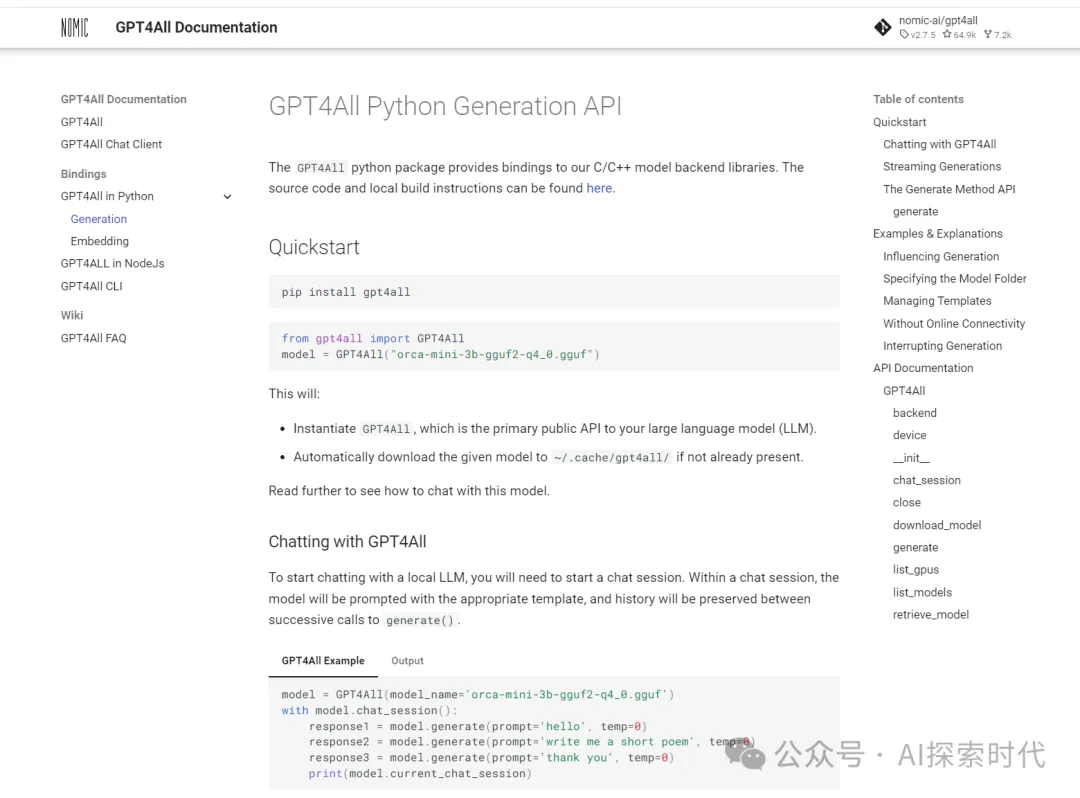

如下图所示,用户可以根据其官方文档,使用不同的编程语言调用大模型的功能接口。以此来实现自己的学习或者企业的应用场景。

GPT4ALL的编程接口

GPT4ALL的python文档

文档地址: https://docs.gpt4all.io/

如下图所示,用户只需要安装python环境,并且使用pip包管理工具,安装gpt4all的包,即可在开发环境中调用大模型的功能。

官方提供了大量已经训练好的模型以供直接使用。

作者在本地使用python调用大模型功能

而如果,你觉得官方提供的大模型功能不合适,那么你还可以根据官方文档进行大模型的训练和微调,定制化一款真正属于自己的大模型。

本文转载自公众号AI探索时代 作者:DFires

原文链接:https://mp.weixin.qq.com/s/A54K0CgXhhp94d6O0n3fWg