视觉文本视频生成最强方案!Text-Animator效果确实好!

文章链接:https://arxiv.org/pdf/2406.17777

github链接:laulampaul.github.io/text-animator.html

视频生成在游戏、电子商务和广告等各行业中都是一个具有挑战性但至关重要的任务。在文本到视频(T2V)生成领域中,有效地在生成的视频中视觉文本是一个尚未解决的重要方面。尽管在文本到视频生成方面取得了一些进展,但现有的方法仍然无法直接在视频中有效地视觉文本,因为它们主要集中在总结语义场景信息、理解和描绘动作。虽然最近在图像级别的视觉文本生成方面的进展显示出了一些希望,但将这些技术转移到视频领域面临着一些问题,特别是在保持文本保真度和运动一致性方面。

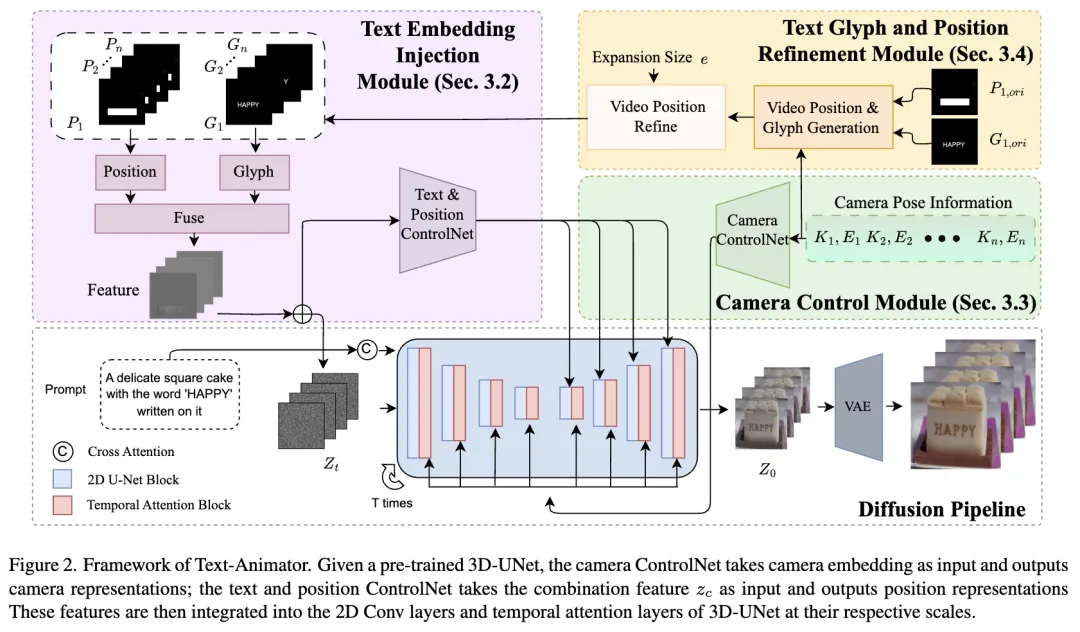

本文提出了一种名为Text-Animator的创新方法,用于视觉文本视频生成。Text-Animator包含一个文本embedding注入模块,可以精确地描绘生成视频中视觉文本的结构。此外,还开发了一个摄像机控制模块和一个文本优化模块,通过控制摄像机运动和视觉文本的运动来提高生成的视觉文本的稳定性。定量和定性实验结果表明,Text-Animator在生成视觉文本的准确性方面优于最先进的视频生成方法。

主要贡献可以概括为:

- 提出了Text-Animator,这是一种新颖的方法,可以在视频中生成视觉文本并保持生成视觉文本的结构一致性。这是首次尝试解决视觉文本视频生成问题。

- 为Text-Animator开发了一个文本embedding注入模块,可以精确描绘视觉文本的结构信息。此外,还提出了一个摄像机控制和文本优化模块,以准确控制摄像机运动和生成视觉文本的运动,从而提高生成的稳定性。

- 大量实验表明,Text-Animator在生成视觉文本的准确性方面,比现有的文本到视频和图像到视频的生成方法有显著的优势。

方法

本节首先介绍Text-Animator的流程。然后分别介绍关键组件的详细信息。

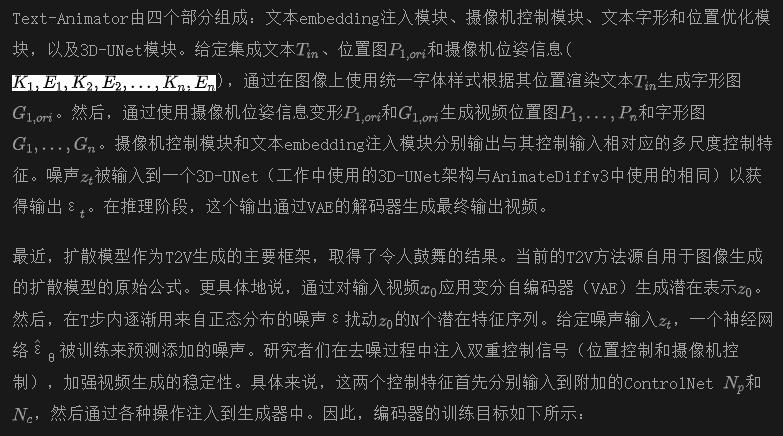

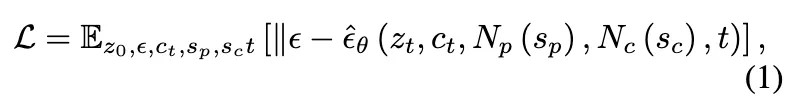

文本条件的视频生成流程

首先,介绍下网络的整体框架,如下图2所示。

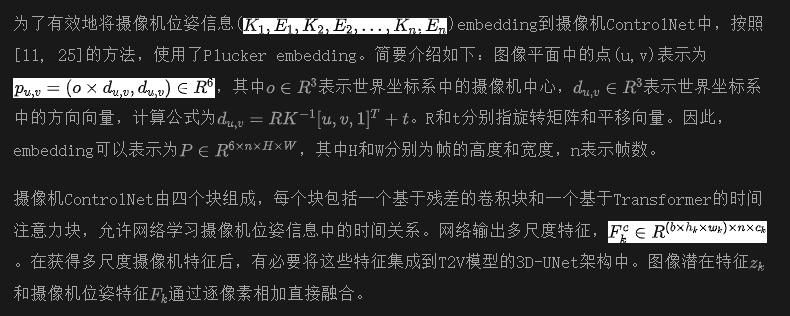

文本embedding注入模块

在生成包含视觉文本的视频时,首先需要考虑的是如何将所需文本的视觉特征有效地embedding到基础模型(预训练的UNet模型)中。受到之前在图像中视觉文本方法的启发,通过结合文本框的位置和渲染的字形,将文本条件embedding到潜在空间中。文本框指示了在生成的图像中进行渲染的位置,而渲染的字形利用现有的字体样式(即‘Arial Unicode’)来预初始化字符的样式。此外,与图像生成不同,视频生成涉及跨多个帧处理特征。为了利用用于图像生成的预训练特征提取器,使用逐帧特征提取器从每个帧中提取特征,然后在输入预训练UNet模型之前连接这些特征。

稳定文本生成的摄像机控制

在引入文本embedding注入模块后,Text-Animator现在能够生成视觉文本视频,并使文本随场景移动。然而,这种文本移动有时会与视频中物体的移动脱节。例如,在提示“写有‘STOP’的标志”中,“STOP”部分可能会向右移动,而标志则向左移动。为了生成更稳定的视频,需要设计额外的控制模块。因此,建议使用摄像机位姿信息来控制文本的移动,并确保与场景内容的一致性。本节主要讨论如何将摄像机位姿信息embedding到基础模型中。

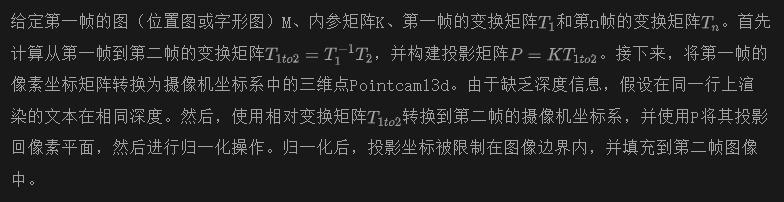

辅助文本字形和位置优化

为了实现摄像机控制模块与文本embedding注入模块之间的协作,有必要使用视频中的摄像机位置信息作为指导,通过考虑第一帧的指导来生成后续帧的位置图和字形图。生成方法如下:

实验

实现细节

选择AnimateDiffV3作为基础文本到视频(T2V)模型。模型的运动模块权重使用AnimateDiffV3进行初始化。其他部分的权重使用DreamShaper或原始的SD1.5进行初始化。摄像机控制网和文本及位置控制网的训练方法和数据集使用[11]和[27]中的方法。最后,将所有部分整合并固定参数进行推理。G和P的图像尺寸分别设置为1024×1024和512×512。扩展尺寸e设置为1.2。在采样过程中,随机选择一些提示语(如“这些文本写在上面:xxx”)并将它们连接到标题上。推理步骤和指导尺度分别设置为25和7.5。最终,模型输出尺寸为16×256×384的视频。

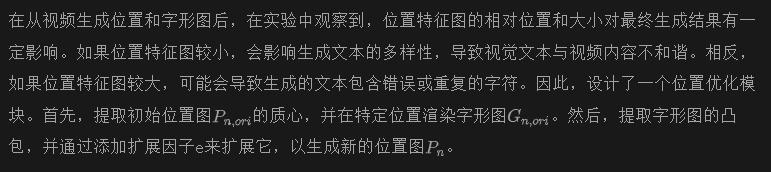

数据集和指标

由于缺乏用于视觉文本生成评估的文本到视频数据集,使用AnyText-benchmark的LAION子集来评估视觉文本视频生成的效果。然而,在该数据集中,有些图像的文本和主要内容是分开的,而有些图像只有文本没有任何图像内容,这对于视频生成是没有意义的。因此,从数据集中选择了约90张图像组成测试集,命名为LAION子集。

首先,需要评估文本生成的准确性和质量。根据论文[27],采用了句子准确率(Sen. Acc)指标,其中每一行生成的文本根据指定位置裁剪并输入OCR模型以获得预测结果。此外,使用归一化编辑距离(NED)来衡量两个字符串之间的相似性。为了确保Text-Animator具有更好的视频生成能力,利用弗里切特embedding距离(FID)来评估生成视频与真实视频之间的视频外观质量。此外,还采用了提示相似性和帧相似性指标。前者评估输入描述与输出视频之间的语义相似性,后者评估生成视频的连贯性。

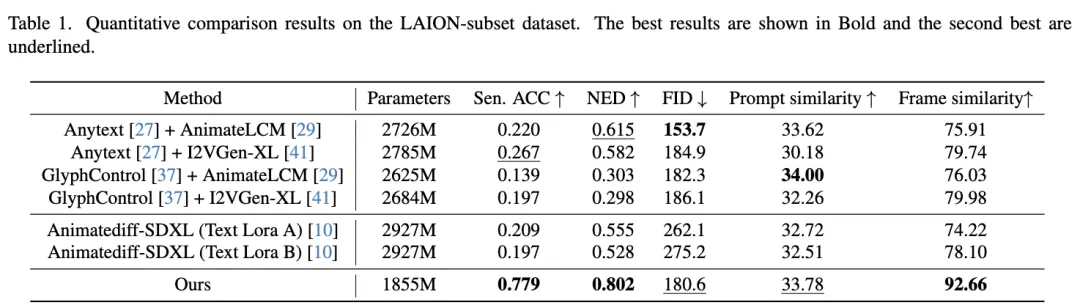

定量结果

定量结果如下表1所示。比较方法分为两部分。第一部分是特定图像视觉文本生成工作的组合(GlyphControl和 Anytext)+ 最先进的图像到视频(I2V)工作(AnimateLCM,I2VGEN-XL)。第二部分是一阶段方法。使用Animatediff-SDXL作为基础模型,并使用CIVIAI的两个微调lora权重,分别表示为Animatediff-SDXL(Text Lora A)1和Animatediff-SDXL(Text Lora B)2。这两个lora权重使用一些具有视觉文本的图像进行微调。从表1可以看出,这些方法的参数比Text-Animator大得多(超过41%)。

此外,Text-Animator在生成视觉文本的准确性方面显著优于其他方法,根据评价指标Sen. ACC和NED(分别比最佳方法高出191.8%和30.4%)。这反映了本文方法生成文本的准确性,且生成的视频中文本没有崩溃。对于衡量生成视频与输入文本相似度的指标(FID和Prompt相似度),Text-Animator取得了第二好的结果。在提示相似度方面,与最佳方法的差距仅为0.6%。在衡量视频稳定性和帧相似度的指标上,Text-Animator取得了第二好的结果。观察到,最佳方法Pika倾向于生成移动较小的视频,使其在该指标上具有优势。

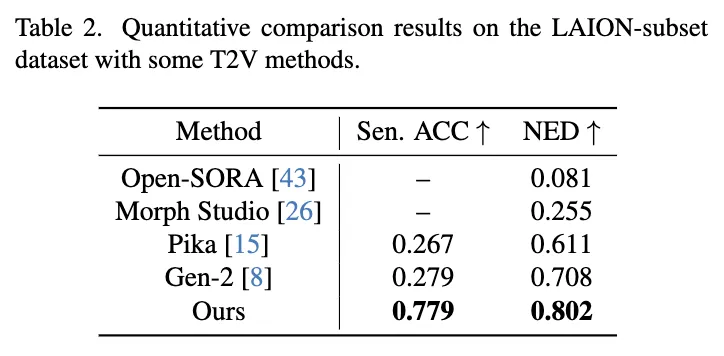

此外,在下表2中,还与Open-SORA和最近的三个最先进API,Morph Studio,Pika 和Gen-2进行了比较。Open-SORA和Morph Studio没有Sen. ACC得分,因为它们无法生成正确的句子或单词。Text-Animator在Sen. ACC方面显著优于其他方法,并且在NED方面也表现优于其他方法。

定性结果

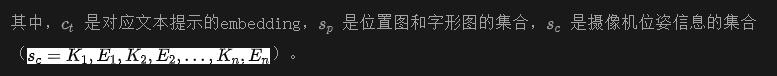

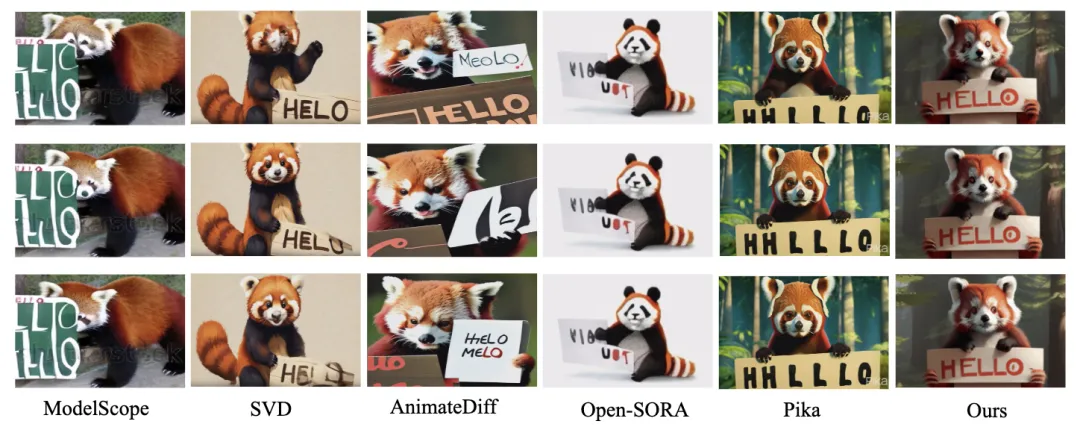

研究者们首先将本文模型与文本到视频生成领域的最先进T2V模型或API进行比较(包括ModelScope、SVD(Stable Video Diffusion)、AnimatedDiff、Open-SORA和Pika),如下图3所示。这些模型展示了对上下文的理解能力,但无法生成特定文本并保持文本一致性。与SVD相比,本文的模型不仅能准确渲染每个字符(本文的:‘HELLO’ vs SVD:‘HELO’或Pika:‘HHLLLO’),而且还能保持一致性。SVD未能学习文本的运动信息,导致文本随着时间的推移变得越来越混乱。

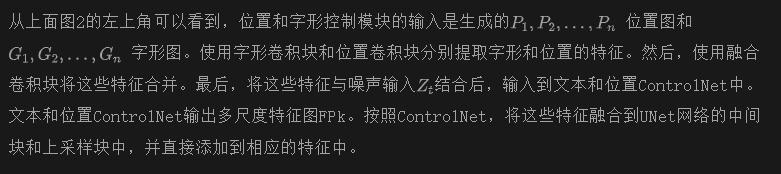

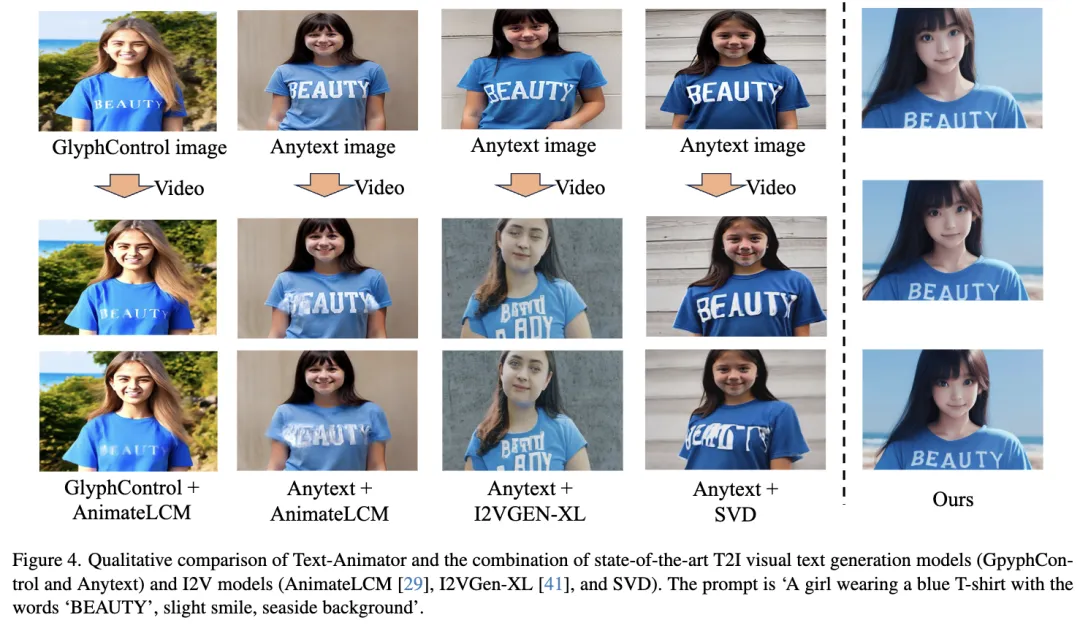

至于与特定视觉文本生成工作的比较,由于目前没有专门为视觉文本生成设计的T2V工作,将Text-Animator与特定T2I工作的组合(如GlyphControl和Anytext)和最先进的I2V工作(如AnimateLCM、I2VGen-XL和SVD )进行对比。如下图4所示,Text-Animator在生成文本与背景的整合方面表现优越,而Anytext无法生成海边背景。当使用I2V方法从参考帧图像生成视频时,文本部分往往会变得模糊或扭曲。Text-Animator很好地保持了文本部分的清晰度,并与图像内容协调移动。

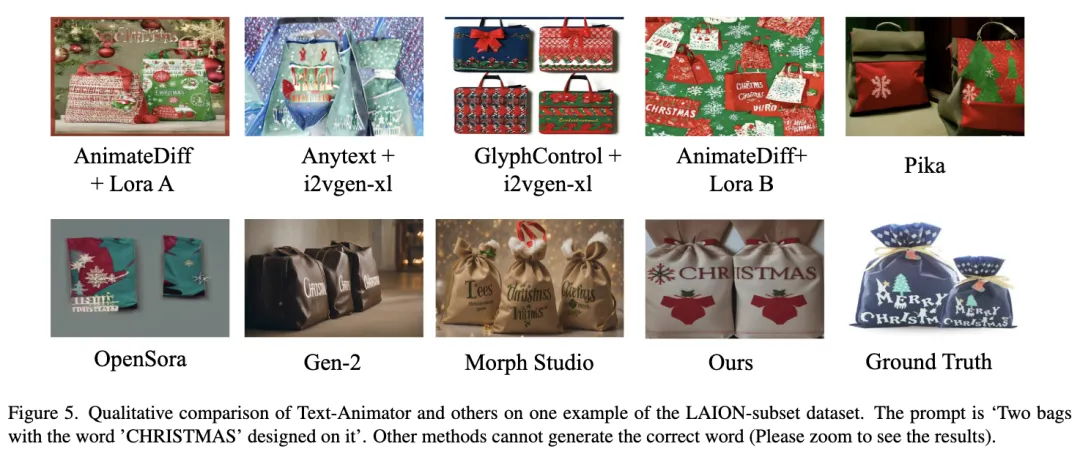

此外,在下图5中,展示了LAION子集数据集的一个示例。只有Text-Animator能够正确显示视觉字符(CHRISTMAS)和包的数量(两个)。

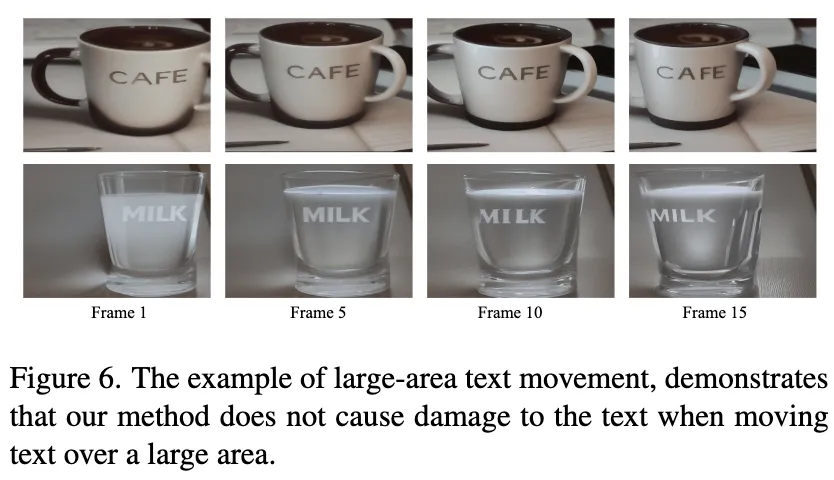

同时,还进行了实验以验证本文方法的鲁棒性。在下图6中,展示了Text-Animator在文本区域大幅移动时的鲁棒性。现有的SOTA方法在小幅移动期间变形了文本区域(如上例所示),因此这些方法的可视化结果未在此展示。这两个示例的文本分别为“带有‘cafe’字样的办公室桌上的咖啡杯”和“带有‘MILK’字样的牛奶瓶”。移动方向从右到左。可以看到,即使在大范围的相机移动下,Text-Animator仍然能够保持文本的结构。

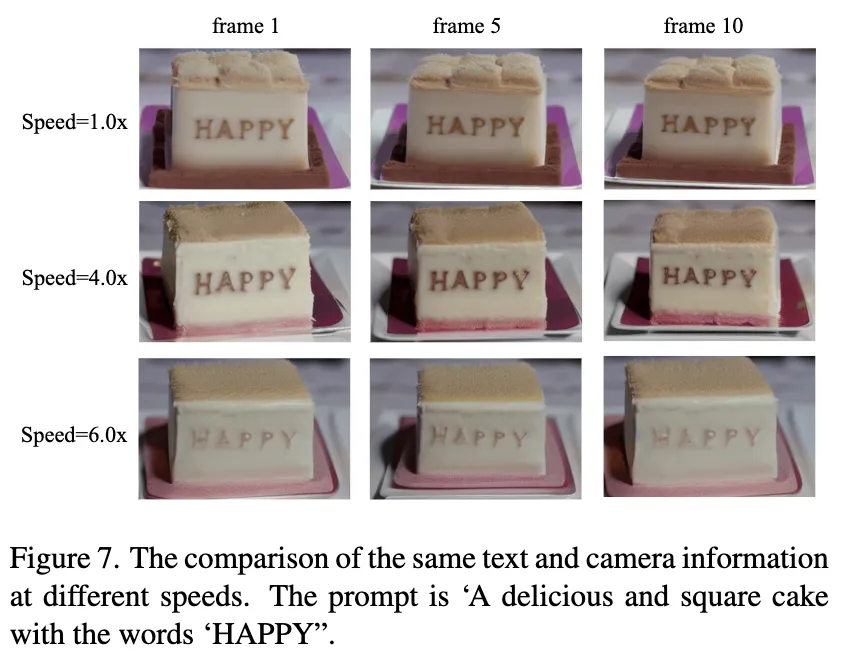

下图7展示了在相同的相机信息下,通过采样间隔帧的相机信息,可以控制其移动速度。即使在原速的4倍或6倍速度下,Text-Animator仍然能够保持文本的结构。

消融研究

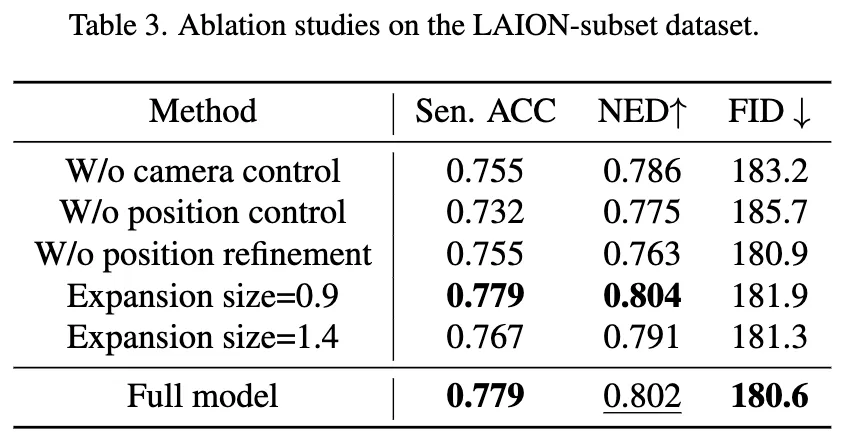

在这一部分中,为了说明本文方法的贡献,在LAION子集上进行了消融研究。定量比较结果如表3所示。

双重控制: 进行了消融研究以分析双重控制设计的有效性。一般来说,仅使用位置框进行引导而不使用相机姿态是可行的。因此,设计了“没有相机控制”的模型,该模型相对于原始模型去掉了相机引导模块。此外,还移除了位置块,仅使用相机姿态和字形embedding,并将此模型命名为“没有位置控制”。在上表3中,可以看到,在NED指标上,“没有相机控制”模型的性能比原始模型下降了0.016,而“没有位置控制”模型的性能比原始模型下降了0.027。

位置精细化和扩展尺寸: 研究者们还进行了实验,以分析提出的精细化模块的有效性。当移除视频位置精细化时,使用LAION子集中的默认位置,并在上表3中将模型表示为“没有位置精细化”。可以看到,使用默认位置会降低准确性。此外,还进行了适当扩展尺寸的实验。尝试了两个扩展系数:0.9(小于1.2)和1.4(大于1.2)。可以观察到,虽然较小的扩展系数提高了视频中文本的准确性,但对视频生成的质量产生了负面影响。另一方面,较大的扩展系数导致一些字符在视频中重复出现,从而降低了文本的准确性。

结论

本文提出了Text-Animator,一种创新的方法,用于解决在视觉文本视频生成领域中将文本元素有效地集成到生成视频中的挑战。Text-Animator不仅强调文本的语义理解,还注重细粒度的文本语义,确保视觉文本在动态集成到视频内容中的同时保持运动连贯性。Text-Animator引入了双重控制机制——相机和位置控制,以同步文本动画与视频运动,从而增强文本元素与视频场景之间的统一性和协调性。通过广泛的定量和视觉实验,证明了Text-Animator在视频质量和文本表示的保真度方面优于现有的T2V和混合T2I/I2V方法。

本文的贡献不仅解决了当前的挑战,还激发了对这一快速发展的多媒体内容生成领域的进一步探索和创新。

本文转自 AI生成未来,作者:Lin Liu等