打开黑盒神经网络!港大推出全新「会说话」的推荐系统大模型XRec,从黑盒预测到可解释

传统推荐系统虽然能给出准确的推荐结果,但缺乏对推荐过程的透明解释,难以让系统更好地理解其兴趣偏好是如何被捕捉和建模的。

最近,香港大学数据智能实验室推出了一款名为 XRec 的全新智能大模型,旨在为传统推荐系统注入可解释性的新动力。XRec 利用大语言模型(LLM)的强大自然语言处理能力,为推荐系统赋予了可解释性,让系统不仅能给出精准的推荐结果,还能用通俗易懂的语言向用户阐述其推荐依据。

代码链接: https://github.com/HKUDS/XRec

论文链接: https://arxiv.org/pdf/2406.02377

实验室链接: https://sites.google.com/view/chaoh

XRec旨在通过整合大语言模型的语义理解能力和协同过滤的用户偏好建模,构建一种「可解释推荐」框架,使推荐系统具备深入洞察用户需求、生成清晰解释的智能化水平。

这种融合自然语言处理和推荐系统的创新尝试,不仅能大幅提升用户体验,增强他们对推荐结果的理解和信任,也将为推荐技术的发展注入新的动力。通过人机协作,XRec能为用户提供更优质的智能服务,为推荐系统的未来发展开辟新的可能性。

通过这种融合语义理解与结构建模的方式,XRec为推荐系统注入了前所未有的智能化。不仅能够生成个性化、贴合用户需求的推荐结果,还能为用户提供富有洞见的背景解释,让他们真正理解推荐的逻辑。这种创新性的范式无疑为未来的个性化服务发展带来了全新的可能。

总的来说,XRec的提出标志着推荐系统正朝着更加智能化和可解释的方向迈进。这一创新成果不仅能满足用户对推荐系统更高的期望,也将为整个推荐技术领域的发展带来新的启示和动力,为推荐系统的未来发展指明新的方向。

模型方法

XRec通过巧妙地融合强大的大型语言模型(LLMs),为推荐系统的输出注入了丰富多彩的自然语言解释。该框架巧妙地整合了协作信号,并采用轻量级的推荐信号适配器,能够深入洞悉用户复杂多变的偏好模式,以及他们与各类物品间错综复杂的交互细节。

值得一提的是,XRec在面临零样本场景时也展现出了出色的泛化能力,能够为前所未见的用户和物品生成富有见地且富有意义的推荐解释。

协同行为关系建模

XRec巧妙地融合了图神经网络(GNNs)技术,以强大的表征学习能力弥补了自然语言在捕捉用户-商品协作关系方面的不足。

在我们的系统中,GNN作为一种"协作信号的tokenizer",将复杂的用户-商品交互模式高效地编码到潜在的嵌入空间中,从而实现了对用户复杂偏好的有效建模。

具体来说,基于图神经网络的消息传递机制,我们的协作图tokenizer在用户-商品交互图上进行信息的传播和聚合,促进了用户和商品节点表征的学习。这不仅能够更好地捕捉节点之间的关联,还能够反映出交互过程中蕴含的复杂模式。

行为与文本语义空间的对齐

表征空间对齐的映射器

XRec的创新之一在于,它配备了一个轻量级但大有作为的适配器模块,用于协调融合不同语义模态间的差异。

我们注意到,用户-商品的交互行为所反映的协同信息,其潜在语义表达空间可能与基于文本的用户/商品语义存在一定差异。

为此,这个适配器模块的作用就是对这些不同的语义模态进行精准对齐,使我们的模型能够高效地整合利用协同信号和文本语义,从而提升整体的建模性能。

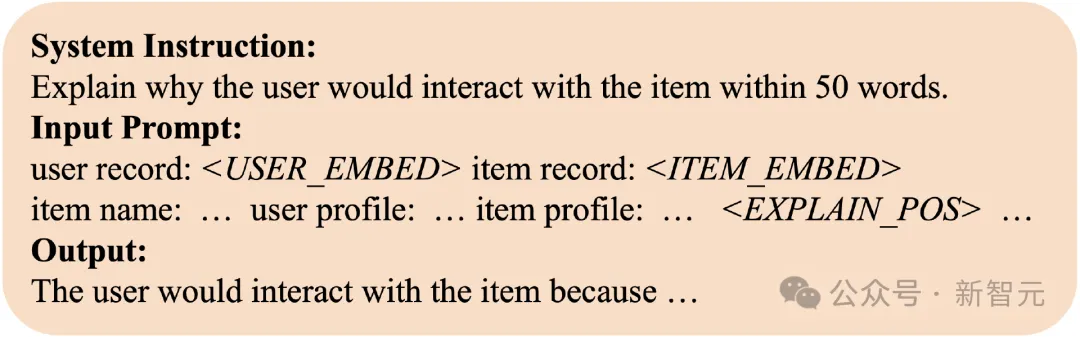

向大语言模型(LLM)注入行为信号

XRec的另一大创新点在于,它能够巧妙地融合协同过滤(CF)技术和大语言模型(LLM)的优势。

在完成前述的语义模态对齐后,我们的系统已做好将丰富的协同信号融入LLM的准备工作。

具体来说,我们会在输入提示中预留特殊标记(tokens),然后将提示转换为token嵌入,最后将已适配的协同信息嵌入注入到这些保留位置中。

XRec的另一个创新之处,在于它采用了一种独特的机制来避免协同信息在融合过程中的损失。我们注意到,随着输入提示长度的增加,分配给每个嵌入token的注意力权重(attention weight)不可避免地会有所减弱,这可能导致本就稀疏的协同信号被稀释。

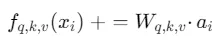

为了解决这一问题,我们将适配后的协同嵌入不仅注入到LLM的初始输入提示中,还扩展到LLM每一个隐藏层的保留位置。具体来说,我们对LLM内部的query、key和value投影函数进行了专门的修改,以更好地促进这一融合过程。

具体来说,我们不仅在LLM的输入阶段注入适配后的协同嵌入a_i,还将其扩展到整个网络的各个隐藏层中。我们运用了LLM内部的查询(query)、键(key)和值(value)投影矩阵W_{q, k, v} ,确保模型能够在整个计算过程中持续访问和整合这些丰富的协同信息。

这不仅保持了协同上下文的强大表征,还使得梯度在回传到专家混合(MoE)模块时更为有效。这种融合设计,充分发挥了LLMs在深层语义理解方面的优势,同时又能充分吸收GNN在捕捉结构模式方面的专长。

模型优化

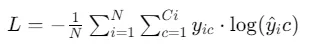

在XRec的模型优化部分,我们着重于提升大型语言模型(LLMs)在生成语境和句法连贯解释方面的能力。我们的核心目标,是最小化预测下一个token的概率与实际下一个token之间的差距。

为此,我们采用了负对数似然(Negative Log Likelihood, NLL)作为训练损失函数,具体公式如下:

其中, N表示每个样本所需生成的解释数量, Ci代表每个解释中的字符数。

和

分别代表实际和预测的token。

这种加权形式的损失函数,能够确保模型在优化预测准确性的同时,也能够关注生成解释的整体连贯性。通过按字符数进行归一化,我们确保了各个解释在损失计算中获得公平的权重,从而推动模型学习生成更加流畅自然的解释文本。

为了降低训练复杂度,我们选择冻结了LLMs内部的所有参数,仅在基于专家混合(Mixture of Experts, MoE)的适配器模型中进行参数更新。这种策略确保了模型能够充分利用LLMs庞大的知识储备,同时又能够灵活地针对特定任务进行优化和精细调整。

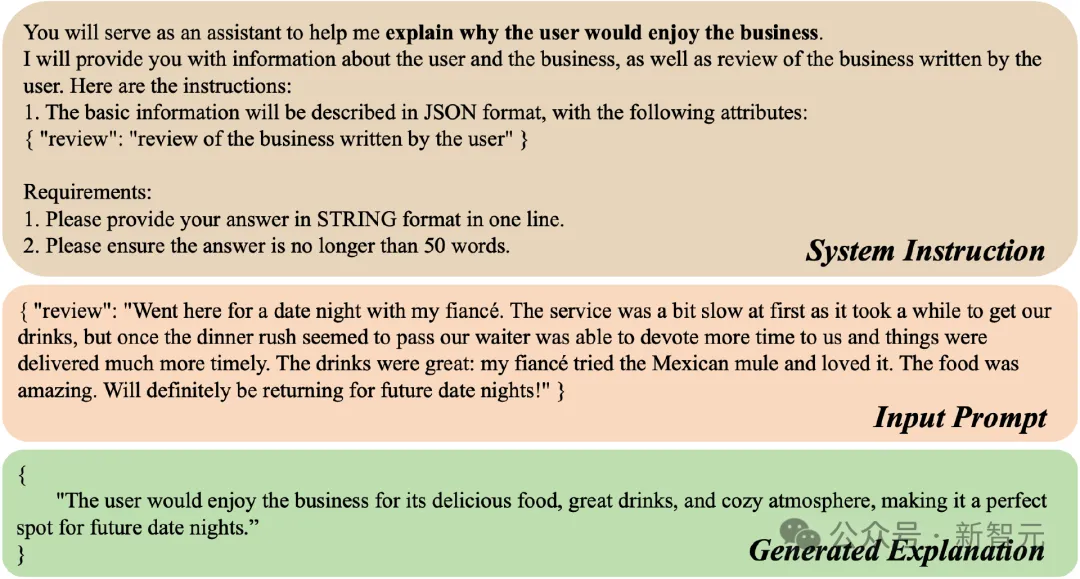

解释文本的优化

基于大型语言模型(LLM)的创新解决方案,XRec能够从原始用户评论中提取出更加明确清晰的用户意图和需求特征,大幅提升基准解释的质量和可解释性。

与简单使用原始评论文本相比,这种基于LLM的分析方法能够洞悉隐藏在表面字面之下的语义内涵,更加深入地捕捉用户的潜在偏好。

模型验证

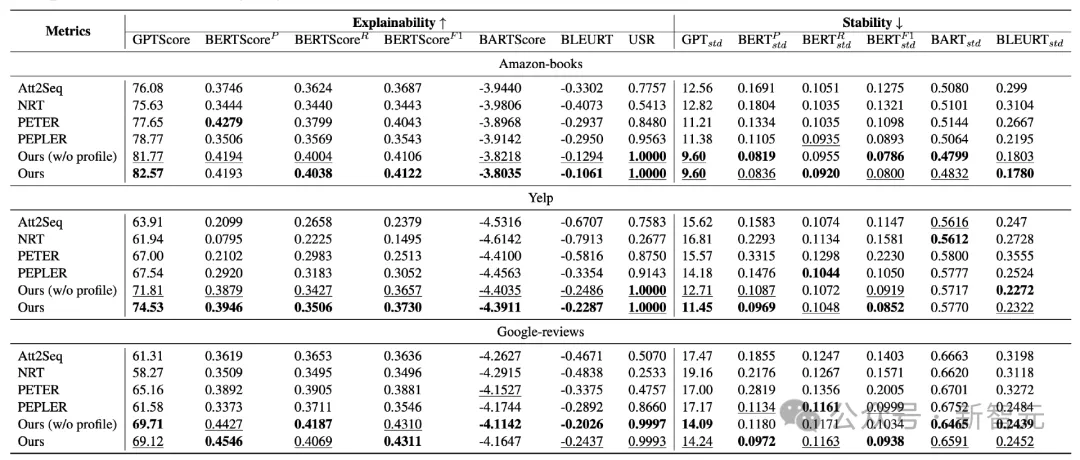

XRec模型在多个公开数据集上的验证实验取得了出色表现。我们利用GPTScore、BERTScore等可解释性指标对模型进行评估,结果显示XRec在可解释性和稳定性方面均明显优于基准模型(Att2Seq、NRT、PETER和PEPLER)。

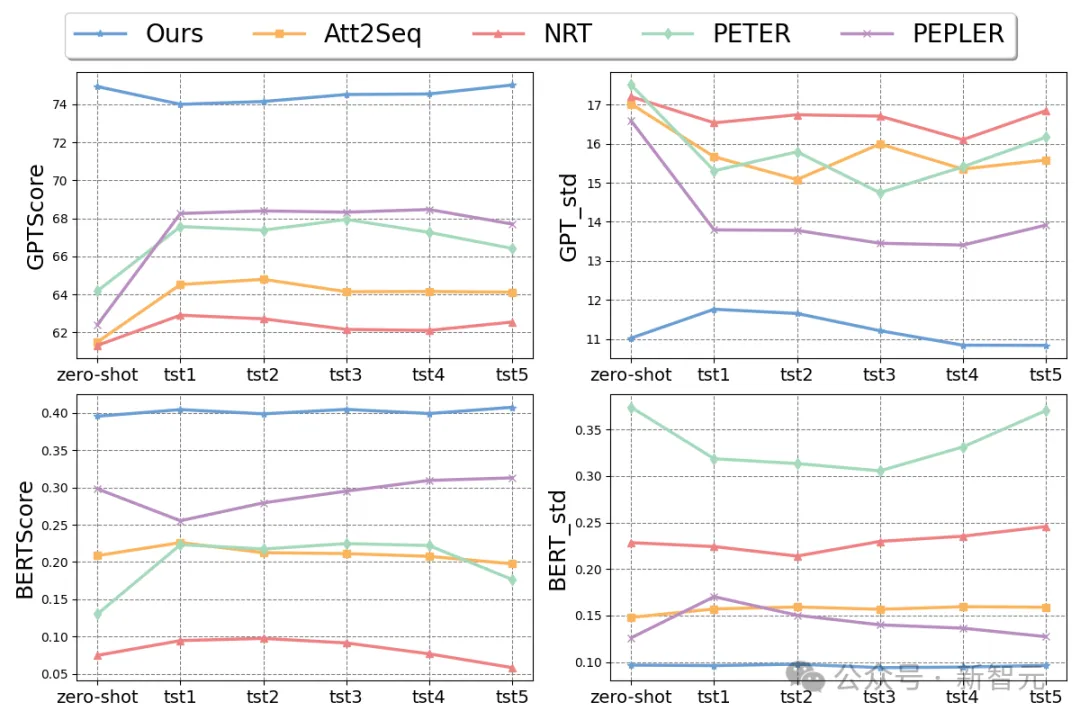

模型鲁棒性的探索

为了更全面地检验模型的泛化能力,我们在不同数据稀疏性的场景下进行了实验。将测试集划分为五个子集(tst1至tst5),涵盖了从罕见到频繁不等的用户群体。

结果表明,XRec不仅在常规用户群体中表现卓越,在零样本场景下(仅包含训练期间未遇到的新用户)也优于基准模型,与其他子集的性能基本持平。这种在冷启动场景下的出色表现,体现了XRec强大的泛化能力,对于新用户的推荐应用具有重要价值。

总的来说,XRec在可解释性、稳定性以及对新旧用户的适应性等方面的优异表现,充分证明了该模型在实际应用中的广泛适用性。无论是用户行为还是项目目录发生变化的动态环境,XRec都能够保持高水平的性能,为推荐系统的智能化升级提供可靠的技术支撑。

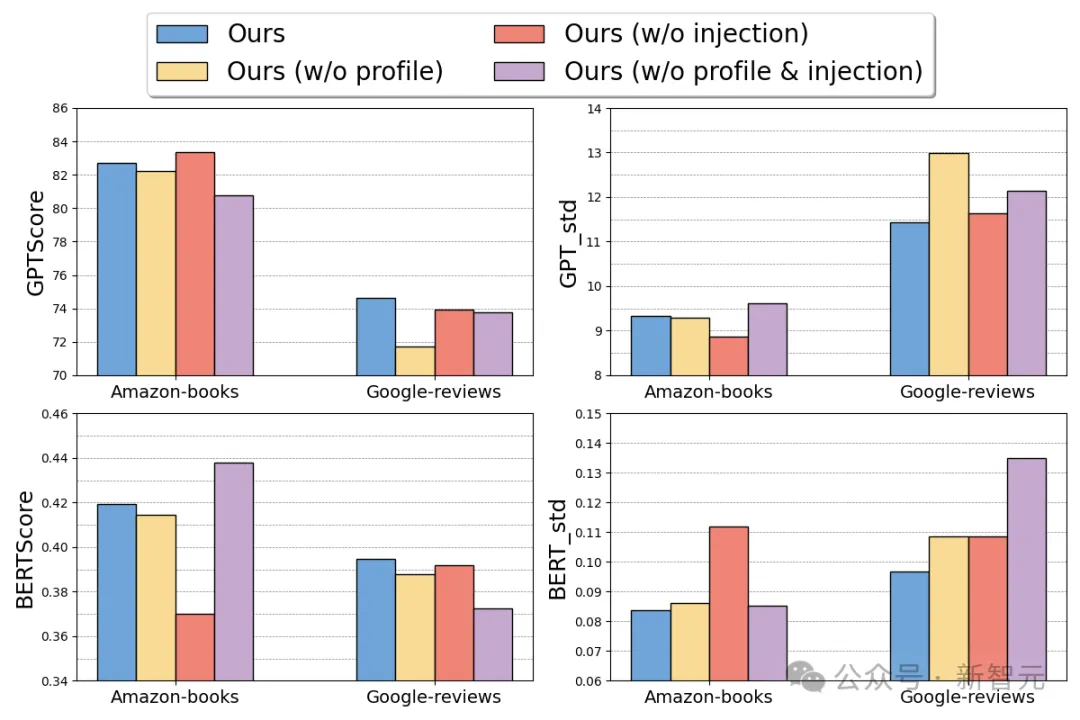

模型消融实验

为了深入探究模型关键组件的影响,我们进行了一系列消融实验。具体来说,我们比较了包含所有特性的完整模型(Ours)与三种变体:

1. 无Profile(Ours w/o profile): 省略了用户和项目属性

2. 无协同信号注入(Ours w/o injection): 保留对齐嵌入在提示中,但未将其注入到LLM层

3. 无属性&协同信号注入(Ours w/o profile & injection): 同时缺少属性和基于协同信号嵌入的注入

我们在Amazon-books和Google-reviews两个数据集上,使用GPTScore和BERTScore这两个可解释性指标对这些变体进行了严格的评估,并比较了它们的标准差。

结果显示,我们的完整模型(Ours)在可解释性和稳定性方面均优于其他变体。这突出了每个组件在推动模型性能和能力方面的关键作用。用户/项目属性以及协同信息的注入,都为模型的出色表现做出了重要贡献。

结语

本研究提出了一种全新的XRec框架,它实现了基于图的协同过滤方法与大语言模型(LLM)技术的有机融合。这种创新设计使得XRec能够为推荐输出生成全面而见解深刻的解释说明。

通过利用用户-商品交互图中蕴含的内在协同关系,XRec有效捕捉到了构成用户偏好和项目关联的高阶依赖性。关键在于,XRec配备了专门的协同信息适配器模块,作为协同信号(collaborative signal)与LLM语义空间之间的关键连接纽带。

广泛的实验结果充分证明了XRec框架的显著优势。它不仅提升了推荐过程的可解释性,而且在具有挑战性的零样本场景中展现出了出色的泛化能力和鲁棒性。这意味着XRec能够更好地满足用户个性化需求,为下一代智能推荐系统开辟新的可能。

本文转自 新智元 ,作者:新智元